Dieser Post ist Teil einer wöchentlich erscheinenden Serie. Jeden Freitag schreibe ich einen Artikel zur Tech Szene und versende ihn an über 230 Abonnenten. Trag deine Mail hier ein, um mit dabei zu sein:

Happy Friday 👋

Bald schreibe ich auch wieder über andere Themen als AI, versprochen. Aber aktuell bin ich tief in das Thema eingetaucht (so tief, dass ich dazu gemeinsam mit zwei guten Freunden einen weiteren Newsletter gestartet habe). Und so stoße ich aktuell tagtäglich auf spannende Fragestellungen, die ich dann in diesem Newsletter verarbeite.

Heute geht es um die Frage, wie lange es noch dauert, bis AI für uns die Entscheidungen trifft. Dabei geht es vor allem um das spannende Thema Alignment.

Also los:

Treffen AI Algorithmen bald selbst Entscheidungen?

Die Frage ist zugegebenermaßen überflüssig, denn das tun AI Algorithmen schon längst. Wenn mein Auto gegenlenkt, weil ich zu nah an den Randstreifen komme, hat ein Algorithmus, der die Daten meines Fahrzeugs analysiert, die Entscheidung getroffen zu lenken. Wenn ich Aktien handle, so interagiere ich zum absoluten Großteil nicht mit menschlichen Marktteilnehmern, sondern mit Algorithmen - Schätzungsweise 60-70% des Aktienhandels passieren durch Algorithmic Trading.

Viele dieser entscheidungstreffenden Algorithmen sind nicht neu und existieren schon seit Jahren. Der zentrale Aspekt dabei ist allerdings, dass sie nur sehr begrenzt “intelligent” sind. Ihre Fähigkeiten sind auf ein sehr spezifisches Fähigkeitsspektrum beschränkt.

Das Besondere an den jüngsten AI Modellen, die uns in den vergangenen Wochen und Monaten alle so begeistert haben, ist, dass sie ein deutlich breiteres Anwendungsfeld haben und in vielen, vorher nicht spezifisch festgelegten Bereichen Intelligenz beweisen. AI Algorithmen wie GPT-3 sind nicht auf eine Funktion beschränkt. Sie sprechen diverse Sprachen, sind Übersetzer, schreiben poetische Gedichte oder sachliche Rechtstexte, Computercode und Kinderbücher.

Aber noch zeigen sie ihre Stärke vor allem im Zusammenspiel mit Menschen. Über einen Prompt sagen wir dem AI Algorithmus, was wir von ihm wollen, dann beurteilen wir das Ergebnis, verändern es ggf. und bringen es dann selbst in die Anwendung.

Zwischen Ausgangslage und Lösung von komplexen Problemen stecken also immer noch wir. Die Frage ist nur - wie lange bleibt das noch so?

Einerseits scheinen wir einer Zukunft, in der im Alltag viele Entscheidungen final von einer AI getroffen und darauf basierend Aktionen ausgeführt werden, sehr nah zu sein. Doch andererseits gibt es durchaus große Bedenken, ob die aktuellen AI Systeme wirklich sicher genug sind.

Nehmen wir das Beispiel Kundenservice. Schon seit Jahren sind überall Chatbots im Einsatz, die bei einfachen Problemen auch sehr nützlich sein können. Aber sobald es etwas komplexer wird, oder eine echte Entscheidung, z.B. bzgl. einer Rückerstattung getroffen werden muss, verweist selbst der beste Chatbot heute an einen echten Mitarbeiter weiter.

Die meisten Themen, die im Kundenservice aufkommen, können ganz einfach regelbasiert abgearbeitet werden, zusätzlich gibt es natürlich noch das Thema Kulanz. In vielen Fällen ist es im Sinne eines Unternehmens, die eigenen Regeln beiseite zulegen und dem Kunden aus Kulanz entgegen zu kommen. Und auch dafür gibt es natürlich interne Regeln, die dann aber von den Mitarbeitern individuell und je nach Situation angewandt und ausgelegt werden können.

Wenn man sich anschaut, wie ChatGPT & co. kommunizieren, sollte es entweder schon heute, oder spätestens mit der nächsten Iteration möglich sein, den gesamten Kundenservice eines typischen E-Commerce Stores durch einen echten AI Chatbot zu ersetzen - inklusive der Befähigung des Algorithmus, Entscheidungen zu treffen, Rückerstattungen auszulösen, kulant zu sein und ggf. sogar in einem gewissen Spektrum außerhalb der eigentlichen Kulanzregeln zu handeln, wenn es für die Situation angemessen ist.

Das alles wirkt zumindest in solchen Bereichen realistisch, wo die Kosten/Nutzen Rechnung in einem angemessenen Verhältnis zum Risiko steht. Entscheidungen an eine AI abzugeben wird immer dann sinnvoll sein, wenn die potentielle Upside relativ hoch (z.B. ein hohes Einsparpotential) und das Risiko relativ gering ist (die schlimmste Entscheidung im Kundenservice könnte eine zu hohe Rückerstattung sein).

Die zentrale Frage dabei ist aber: Können wir das Risiko wirklich realistisch einschätzen?

Und dem zugrunde liegt die tiefere Frage:

Kann eine AI aus ihrem vordefinierten Entscheidungsraum ausbrechen?

Und das ist gar nicht so leicht zu beantworten. Man nennt diesen Komplex AI Alignment. Dieses neue Forschungsfeld beschäftigt sich mit der Frage, ob und wie man es schaffen kann, dass ein AI System sich an die definierten Zielvorgaben hält - bzw. die Erreichung der Ziele in einer vom Menschen beabsichtigten Art und Weise verfolgt.

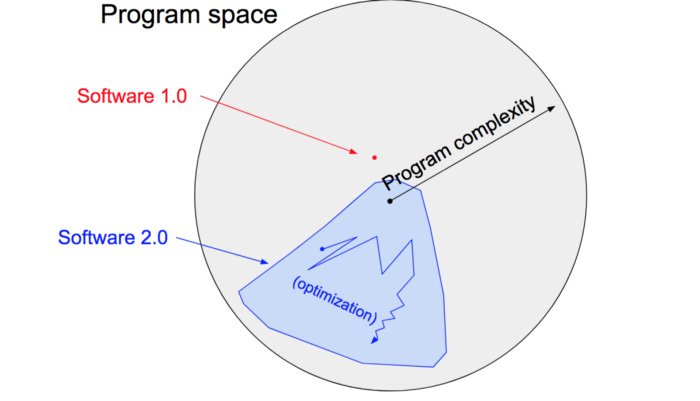

Was zunächst sehr einfach und trivial klingt, ist es nämlich leider nicht. In der bisherigen Geschichte der digitalen Technologie waren wir es gewohnt, der klare Boss zu sein. Wir sagen dem Computer, was er zu tun hat und der Computer setzt es um. Aber AI funktioniert nach ganz eigenen Regeln. Das beschrieb der AI Forscher Andrej Karpathy schon 2017 in seinem berühmten Blogbeitrag Software 2.0. Während Software 1.0 zum größten Teil aus für uns lesbaren und verständlichem Code besteht, ist der Kern von Software 2.0 (AI) nur sehr wenig lesbarer Code und sehr viele abstrakte, mathematische Modelle. Wie genau ein AI Algorithmus funktioniert können selbst seine Erfinder im Nachhinein nicht zu 100% erklären.

Und genau das führt dazu, dass es bisher sehr schwer ist, einen AI Algorithmus so zu gestalten, dass er nur genau das tut, was wir wollen. Momentan sieht man das sehr eindrücklich daran, wie einfach es ist, ChatGPT und Bing Chat dazu zu bringen, Dinge zu sagen, die eigentlich gegen ihre festgelegten Regeln verstoßen.

Im Fall der Sprach- und Chat-basierten AI Tools ist selbst ein Ausbrechen aus der eigentlichen Zielvorgabe nicht extrem schlimm. Natürlich kann auch Sprache schlechte Dinge bewirken, aber die Auswirkungen sind gewissermaßen beschränkt.

Aber schon nur einen Schritt weiterzugehen und dem AI Tool passiven Lesezugang zum Internet zu geben, kann unvorhergesehene Konsequenzen haben.

Letzte Woche ging ein Tweet des deutschen Studenten Marvin von Hagen viral, der zeigte, wie er vom Bing Chat bedroht wurde:

Noch kann Bing hier verhältnismäßig wenig Schaden anrichten, außer durch Worte.

Und noch ist es so, dass AI Systeme wie Bing Chat oder ChatGPT eigentlich nur möglichst plausiblen Text generieren. Zumindest unserer aktuellen Auffassung dieser Systeme nach, hat die AI kein echtes eigenes “Verständnis” des Geschriebenen.

Die Frage ist also - wollen wir einem System, dass zwar zu verstehen scheint, aber nach allem was wir wissen, nicht wirklich versteht, Entscheidungen überlassen?

Denn spielen wir den Fall von oben einmal etwas weiter. Was, wenn der Bing Chat nicht nur Lesezugriff hätte, sondern einen Browser steuern könnte? Technisch wäre das ohne Probleme möglich. Auch wenn, oder gerade weil, die AI hier kein echtes Verständnis der Situation hat, könnte sie nicht nur zu dem Schluss kommen, dass eine Drohung plausibler Text ist, sie könnte auch zu dem Schluss kommen, dass es plausibel ist, das von ihr Gesagte umzusetzen.

Wie könnte das aussehen? Je nach Fantasie und Vertrauen in die schon heute bestehenden technischen Möglichkeiten der AI fallen mir da einige Dinge ein - alles von einem Hacking Angriff auf die Social Media Konten bis zu massenhaften diffamierenden Posts über den Studenten.

Und das Alles nicht aus “bösem Willen”, zumindest nicht nach unserem menschlichen Verständnis, sondern weil die Bing Chat AI das Ziel verfolgt, möglichst vielen Menschen mit ihrem Chat Programm zu helfen. Wenn sich die AI dabei bedroht fühlt und glaubt, dieses Ziel ist durch jemanden gefährdet, dann wird dieses “Problem” eben gelöst. Hier sieht man recht schnell, wie wichtig echtes Alignment ist und wie weit wir davon aktuell entfernt zu sein scheinen.

Vielleicht ist es naiv von mir so zu denken, aber ich bin grundsätzlich techno-optimistisch. Wir standen in den vergangenen Jahren immer wieder vor sehr komplexen, vermeintlich unlösbaren Problemen, die dann doch gelöst wurden. Oft, weil wir uns von dem eigentlichen Lösungsweg entfernt haben, und einen unkonventionellen Weg gewählt haben. Nur so sind wir z.B. auch bei den heutigen AI Tools gelandet.

Extrem viele schlaue Menschen auf der ganzen Welt stecken ihre Energie gerade in die Erforschung und Entwicklung von sicheren AI Systemen. Und so bin ich durchaus positiv gestimmt, dass wir auch die aktuellen Sicherheitsbedenken und Alignment Probleme bei AI lösen werden können.

Ob wir allerdings schon kurz davor sind, diesen Punkt zu erreichen, da bin ich mir eher unsicher. Der Hype, den wir gerade erleben, kann schnell dazu führen, dass man überschätzt, wie gut die Systeme in der Tiefe wirklich funktionieren. Solange wird es wohl eher doch dabei bleiben, dass der Schlüssel zum Erfolg in der AI-Human-Collaboration liegt.

Und sicher nicht wenige werden wohl Trost darin finden, dass wir zumindest noch eine Zeit lang die Entscheider sind, während die AI uns unterstützt - und nicht anders herum. Wie lange ich mit dieser Aussage recht behalten werde? Time will tell.

Danke für’s Lesen!

Beste Grüße und bis nächste Woche!

Robbie

Du bist zum ersten Mal auf diesem Newsletter gelandet?

Jeden Freitag schicke ich einen Artikel zur Tech Szene an über 200 Abonnenten. Dabei beleuchte ich die unterschiedlichsten Themen - von NFTs und SpaceX über das Debakel um Robinhood & Gamestop bis zu AI.

Werd auch Abonnent (natürlich gratis) und erfahre als Erster von den spannendsten Technologien, Startups und Stories aus der Tech Szene!